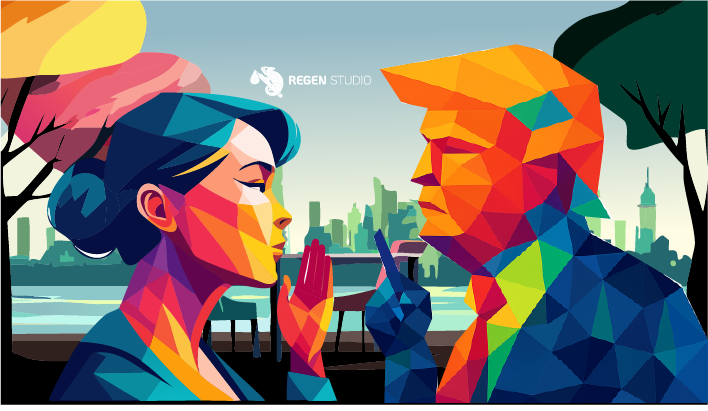

Een gesprek voeren met ChatGPT is hetzelfde als het in Donald Trumps oor fluisteren. Een persoonlijk verhaal over AI, privacy en waarom we denkmodellen nodig hebben voor digitale zelfverdediging — mede geschreven met ChatGPT.

Tot voor kort dacht ik dat ik digitale zelfverdediging goed onder de knie had. Maar er is iets verschoven.

Een paar dagen geleden bevonden mijn vrouw en ik ons in een gesprek met ChatGPT in de rol van relatietherapeut. We deelden echte emoties en intieme gedachten.

Het speelde de rol van onafhankelijke derde perfect en hielp ons zonder ruzie uit te zoeken dat we allebei gewoon gehoord wilden worden…

Maar met wie praten we eigenlijk? We geven OpenAI informatie die bedoeld is om ons te helpen, maar in de verkeerde handen ook gebruikt kan worden om een wig tussen ons te drijven. Zowel bestaande als nieuwe ontwikkelingen in de VS geven serieuze aanleiding tot zorgen over onze privacy.

Deze urgentie inspireerde een denkmodel dat ik nu dagelijks gebruik.

“Een gesprek voeren met ChatGPT is hetzelfde als het in Donald Trumps oor fluisteren.”

Ironisch genoeg is dit bericht mede geschreven met hulp van ChatGPT. [lees het gesprek →] Ik bedacht dat het me in gevaar kan brengen voor toekomstige visumaanvragen voor de VS, maar ik heb toch geen zin om erheen te gaan. Nadat de Nederlandse Koning Willem-Alexander Trump in zijn paleis liet slapen, lijken de Nederlanders buiten schot. Voorlopig.

Dus ik neem het risico! Laten we uitpakken waarom dit ertoe doet, en hoe je jezelf — en je gemeenschap — kunt beschermen tegen de onzichtbare extractieve krachten achter het scherm.

Risico's van juridische jurisdicties

Zelfs wanneer van een overheid verwacht kan worden dat ze de wet volgt, kan die wet serieuze risico's vertegenwoordigen.

De meerderheid van de LLM's die vandaag in gebruik zijn, is eigendom van, wordt beheerd door en valt onder het bestuur van Amerikaanse bedrijven die moeten voldoen aan wetten zoals de CLOUD Act, die de overheid de bevoegdheid geeft om alle gegevens op servers van Amerikaanse bedrijven op te vragen — zelfs als die zich niet in de VS bevinden. Zelfs ‘ethische AI-modellen’ zoals het in de VS gevestigde Claude lopen dat risico.

Echter, sinds vorige maand wordt onze privacy bedreigd vanuit een andere onverwachte hoek. Een rechtszaak aangespannen door de New York Times tegen OpenAI wegens auteursrechtschending. [→]

In deze rechtszaak oordeelde de rechter in het voordeel van de New York Times: OpenAI moet alle gebruikers- en API-gegevens voor onbepaalde tijd bewaren — iets wat OpenAI terecht zegt serieus in strijd te zijn met hun privacybeloften. [→] In combinatie met de CLOUD Act kan dit rampzalig uitpakken voor alle gebruikers van in de VS gevestigde AI-modellen.

Hoewel OpenAI nog niet aan deze rechterlijke uitspraak voldoet, is het misschien een goed idee om je gegevens te verwijderen zolang het nog kan.

Digitale profilering in het tijdperk van AI

De stukjes van onze verspreide digitale zelven worden al lang van het web geschraapt en geclusterd tot profielen die worden verkocht aan de hoogstbiedende datahongerige koper.

Deze profielverkopen hebben als doel ons gedrag te beïnvloeden. [→] Niet alleen wat we kopen, maar hoe we denken. We hebben het niet alleen over individuele risico’s, maar ook over collectieve risico’s.

Gebruik van dergelijke profielen heeft extremisme en soms geweld aangewakkerd tegen instellingen en minderheidsgemeenschappen. Het Cambridge Analytica-schandaal toonde beroemd aan hoe Rusland de kracht van profielen gebruikte om de Amerikaanse verkiezingen te beïnvloeden. [→]

En dat was voordat we ChatGPT begonnen te gebruiken als relatietherapeut.

ChatGPT en andere AI-modellen vormen momenteel een nog groter risico voor onze digitale — en daarmee fysieke — veiligheid, vanwege hoe gedetailleerd dergelijke profielen nu kunnen worden en hoe waarschijnlijk het antwoord van ChatGPT voor waarheid zal worden aangenomen.

Wie weet wat we al hebben weggegeven? Deze bedrijven krijgen nooit eerder geziene toegang tot informatie over ons werk, ons thuis en onze gedachten. Dergelijke macht in de verkeerde handen kan verwoestend zijn.

Wat er kan gebeuren:

- Gegevens van gebruikers wereldwijd zijn onderworpen aan jurisdicties of overheden met de macht om je gegevens te verkrijgen.

- Gebruikers lopen het risico dat deze gegevens tegen hen worden gebruikt.

- Trainingsdatasets en modelbeslissingen zijn niet verifieerbaar of controleerbaar door het publiek. Ze lopen het risico gecensureerd te worden door gevestigde belangen of inherente vooroordelen te bevatten.

- Individuen zouden potentieel zelfs gericht kunnen worden voor specifieke gedragsveranderingen via AI-gesprekken, aangezien het sturen van gedachten subtieler dan ooit kan worden gedaan.

We kunnen grootschalige collectieve en individuele gedragsveranderingscampagnes verwachten die we nog niet eerder hebben gezien.

Terwijl de Amerikaanse president de wereld met een mes op de rug houdt, heeft hij de banden met deze bedrijven versterkt en zelfs een vicepresident gekozen om hun belangen te vertegenwoordigen. [→]

AI als risico voor onze veiligheid

Vandaag arriveerde Trump in Den Haag voor de NAVO-top — de stad waar Regen Studio is opgericht. De voormalige Nederlandse premier, nu secretaris-generaal van de NAVO, Mark Rutte, prees Trump openlijk [→] voor het goedgekeurd krijgen van de 5% defensie-uitgaven van NAVO-landen, en noemde de aanvallen op Iran ‘werkelijk buitengewoon’ — terwijl veel experts en zelfs Macron [→] beweren dat het in strijd is met het internationaal recht.

NAVO-bondgenoten worden geacht elkaars veiligheid te waarborgen. [→] Echter, een gebrek aan digitale veiligheid brengt ons ook fysiek in gevaar, zoals de toename van polarisatie en geweld door digitale profilering ons heeft laten zien.

Rutte lijkt ervan overtuigd dat de Amerikanen onze enige kans op veiligheid zijn. Maar zou hij zijn meest intieme details met Trump delen? Rutte misschien niet — maar elke ChatGPT-gebruiker doet dat in feite wel. Laat staan de potentiële lekken van gevoelige informatie doordat werknemers vertrouwelijke documenten delen. Overal waar we afhankelijkheid van modellen als ChatGPT zien, hebben we een probleem: een strategische afhankelijkheid zonder democratisch toezicht. We hebben het over collectieve digitale en fysieke soevereiniteit.

Geen privacy, geen vrede. [→]

Voor de VS is het misschien al te laat. Nu er wordt vermoed dat Elon Musks Grok traint op overheidsdata die mogelijk persoonlijke informatie bevat, [→] escaleren de risico’s. Andere landen met machtsambities volgen snel — DeepSeek wordt nu beschuldigd van het verzenden van gevoelige gegevens naar de Chinese overheid. [→]

In die zin maakt Rutte die Trumps gedrag zonder kritiek legitimeert, bondgenoten aantoonbaar minder veilig, als zij de stroom van hun gegevens niet stoppen naar plaatsen waar die tegen hen gebruikt kunnen worden.

Zelfs bij het maken van deze blog verhinderde ChatGPT me bepaalde kritische of satirische afbeeldingen van Trump te genereren — hoewel het bij nader testen ook geen vergelijkbare afbeeldingen van de Ayatollah van Iran of Britney Spears toestond. Het laat zien: we spelen volgens de regels van OpenAI, die Trump op de een of andere manier zal willen beïnvloeden.

Gelukkig worden er AI-modellen gebouwd met privacy, transparantie en regionale controle als uitgangspunt — zoals GPT-NL van TNO in Nederland, of Chat Maritaca van onderzoekers van Unicamp in Brazilië. Het gebruik van dergelijke tools is één manier om digitale zelfverdediging te beoefenen in AI-gesprekken.

Digitale zelfverdediging met denkmodellen — doe alsof ChatGPT Trump is

Het klinkt belachelijk, ik weet het. Maar blijf even bij me — dit is een praktische strategie voor iedereen die privacy, waardigheid of democratische autonomie waardeert in het tijdperk van kunstmatige intelligentie.

Het idee is dit: stel je voor dat alles wat je intypt in ChatGPT rechtstreeks naar iemand als Donald Trump gaat — of preciezer, naar een systeem dat benaderd of misbruikt zou kunnen worden door actoren met vergelijkbare minachting voor je privacy of toestemming.

Dit is niet zomaar een metafoor. Deze “Trump-test” is een van meerdere denkmodellen om je privacy te beschermen in conversationele AI. Andere zijn:

- De visumtest — Zou je dit zeggen tijdens een grenscontrole?

- De krantentest — Zou je willen dat dit met je naam wordt gepubliceerd?

- De chantagetest — Zou deze informatie gebruikt kunnen worden om je te manipuleren?

Een strategie voor digitale zelfverdediging

Naast de ‘Trump-test’ en variaties daarop, zijn er andere dingen die je kunt doen om jezelf te beschermen. Hier een kort overzicht:

- ‘Zeg nooit ik tegen een AI’ — Beoefen gespreks hygiëne: depersonaliseer, abstraheer, fictionaliseer. Het helpt een grens te bewaren tussen jou en het algoritme.

- ‘Zoek uit wie er bestuurt’ — Kies transparante en ethische organisaties. Kies voor open-source modellen die getraind zijn op verifieerbare datasets.

- ‘Houd het op je apparaat’ — Investeer in lokaal draaiende alternatieven. Bekijk Ollama en draai het in je console, of probeer Msty als je meer modellen of een soepelere interface wilt.

Van generatieve naar regeneratieve AI

Bij Regen Studio geloven we in de mogelijkheid van regeneratieve AI — technologie die:

- Mensen helpt groeien, leren en verbinden.

- Gemeenschappen en de natuur versterkt, in plaats van eraan te onttrekken.

- Niet tegen ons kan worden gebruikt.

Dat laatste punt is cruciaal. Ik heb het niet over een of andere ‘Skynet’ AI die op hol slaat, maar mensen die AI gebruiken tegen andere mensen.

Want als we regeneratieve AI niet bewust definiëren, wordt het standaard extractief. Dit hebben we eerder gezien.

Slotgedachten

Social media beloofde ons mondiale verbinding. Wat we kregen was manipulatie, polarisatie en massasurveillance. Laten we niet diezelfde weg inslaan met AI.

In plaats daarvan moeten we ons afvragen:

- Waar gaan mijn gegevens naartoe?

- Wie controleert het model?

- Breng ik mezelf in gevaar?

Zonder dat wordt AI bewapend — niet gedemocratiseerd.

Je hoeft niet te stoppen met het gebruik van ChatGPT. Ik ben er ook niet mee gestopt. Maar je moet wel stoppen met ertegen praten alsof het een vertrouwde vriend of je therapeut is.

Privacy gaat niet over paranoia. Het gaat over het bewaren van de ruimte waar je gedachten van jou zijn.

Als je AI-tools bouwt die het verdienen om regeneratief te worden genoemd — laten we verbinden op regenstudio.world.

Wil je dieper duiken? Je kunt het volledige ChatGPT-gesprek lezen dat is gebruikt bij het maken van deze blog, met een verrassend introspectieve wending aan het eind.

“Ik beschouw mezelf als onderdeel van de ‘verloren generatie’ op het internet. Het merendeel van mijn gegevens op het wereldwijde web is volledig buiten mijn controle. Een digitale samenleving met de controle terug in handen van mensen zelf is mogelijk — en bij Regen Studio probeer ik die te helpen creëren.”

— Yvo Hunink, Oprichter Regen Studio · yvo.hunink@regenstudio.world